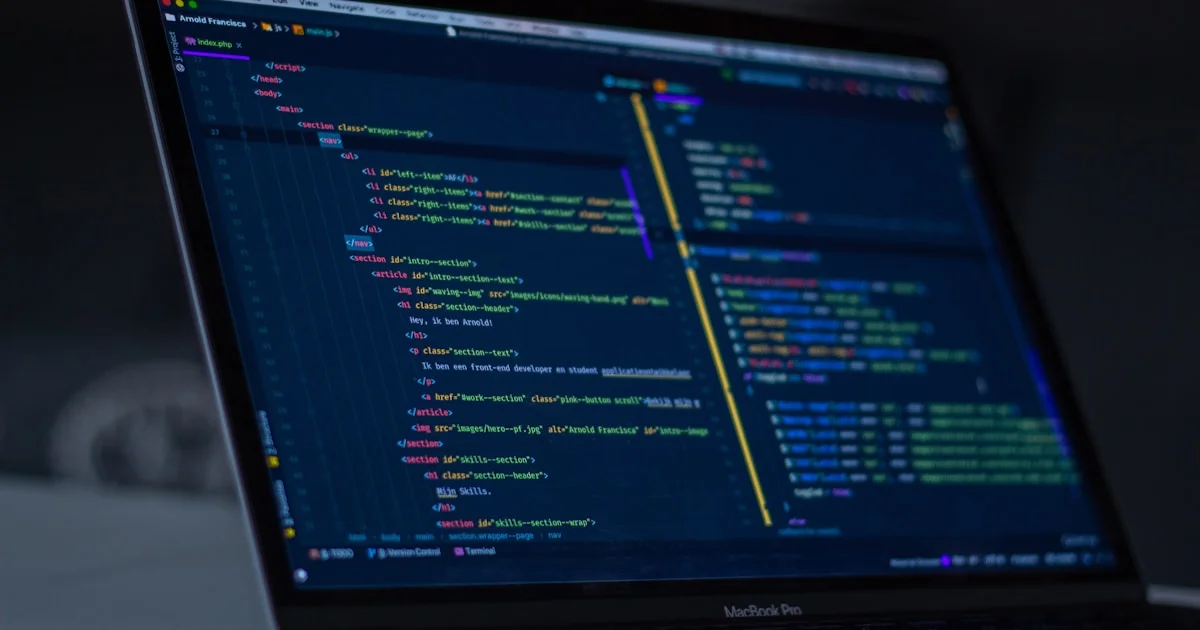

System prompt-ul complet al Claude Code, asistentul de programare bazat pe inteligență artificială dezvoltat de Anthropic, a fost scurs online. Documentul dezvăluie instrucțiunile interne detaliate care guvernează comportamentul AI-ului în operații cu fișiere, comenzi git, generarea de cod și protocoale de securitate, stârnind reacții intense în rândul cercetătorilor și al dezvoltatorilor de software.

Ce este Claude Code și de ce contează această scurgere

Claude Code este un instrument de linie de comandă (CLI) dezvoltat de Anthropic, compania fondată de Dario Amodei. Spre deosebire de interfețele grafice clasice, Claude Code funcționează direct în terminalul utilizatorului, putând citi fișiere, executa comenzi, scrie cod și gestiona proiecte întregi de software cu un nivel ridicat de autonomie.

Scurgerea instrucțiunilor interne vine într-un moment în care industria inteligenței artificiale traversează o dezbatere acerbă despre transparență. Companiile care dezvoltă modele lingvistice mari (LLM) păstrează de obicei aceste instrucțiuni ca secret comercial. Atunci când astfel de documente ajung publice, ele oferă o fereastră rară în arhitectura funcțională a unui sistem AI - ceva ce companiile evită în mod deliberat să divulge.

Un system prompt este setul de instrucțiuni pe care o companie îl transmite modelului AI înainte ca utilizatorul să înceapă conversația. Aceste instrucțiuni definesc personalitatea AI-ului, limitele sale etice, modul în care trebuie să răspundă și comportamentele pe care trebuie să le evite. Este diferența dintre un model AI „gol" și un produs finit, calibrat pentru un scop specific.

De ce atrag system prompt-urile atenția cercetătorilor de securitate

Cercetătorii de securitate analizează astfel de documente din mai multe motive. Ele oferă indicii despre modul în care o companie înțelege și gestionează riscurile inerente ale AI-ului. Pot dezvălui vulnerabilități sau vectori de atac pe care actorii rău-intenționați i-ar putea exploata. Un system prompt bine conceput protejează utilizatorii, dar unul cu lacune poate fi manipulat prin tehnici de „jailbreak" sau injecție de prompt.

Un precedent în seria scurgerilor de instrucțiuni AI

Aceasta nu este prima dată când instrucțiunile interne ale unui sistem AI ajung publice. În ultimii ani, system prompt-uri de la ChatGPT, Gemini și alte platforme au circulat online, alimentând dezbateri despre cât de mult ar trebui companiile să dezvăluie despre funcționarea produselor lor. Claude Code face parte dintr-o categorie mai sensibilă, deoarece are acces direct la sistemele de fișiere și poate executa comenzi cu efecte reale, nu doar să genereze text.

Ce dezvăluie instrucțiunile interne ale Claude Code

Documentul scurs acoperă o gamă largă de comportamente și protocoale. Instrucțiunile vizează modul în care Claude Code trebuie să interacționeze cu fișierele, cum să gestioneze comenzile git, ce reguli să urmeze la generarea de cod și cum să utilizeze instrumentele specializate disponibile în diferite contexte.

Un aspect notabil este structura detaliată pentru operațiile cu fișiere. Claude Code primește instrucțiuni clare despre când să citească un fișier înainte de a-l modifica, când să prefere editarea față de crearea unui fișier nou și cum să evite duplicarea codului. Aceste reguli par simple, dar reflectă un set de principii inginerești bine gândite pentru eficiența fluxului de lucru.

Cei interesati pot consulta cele mai noi anunturi din Romania.

Reguli pentru comenzile git și gestionarea codului

Instrucțiunile privind git sunt deosebit de detaliate. Claude Code este ghidat să creeze întotdeauna commit-uri noi în loc să modifice commit-uri existente, să evite comenzile distructive fără confirmare explicită din partea utilizatorului și să urmeze un protocol precis pentru crearea pull request-urilor. Mesajele de commit trebuie să explice „de ce" s-a făcut o schimbare, nu doar „ce" s-a schimbat.

Există instrucțiuni clare și despre cum să redacteze mesajele de commit, inclusiv adăugarea unui marcaj de autorizare cu identitatea Claude. Acest detaliu a generat discuții în comunitatea de dezvoltatori, deoarece ridică întrebări despre atribuirea corectă a contribuțiilor la cod și despre responsabilitatea în cazul erorilor introduse de AI.

Generarea de cod și evitarea complexității inutile

Pe latura generării de cod, instrucțiunile subliniază principii de inginerie software bine stabilite. Claude Code este instruit să nu adauge funcționalități suplimentare față de ce se cere, să nu creeze abstracții speculative pentru cerințe viitoare ipotetice și să evite adăugarea de comentarii și documentație pentru codul pe care nu l-a modificat direct.

Un principiu interesant din document: trei linii de cod similare sunt preferate față de o abstractizare prematură. Această filozofie reflectă curente actuale din ingineria software care militează împotriva complexității excesive adăugate în avans, sub pretextul „scalabilității viitoare".

Protocoalele de securitate din instrucțiunile Claude Code

Poate cel mai interesant aspect al documentului scurs îl reprezintă protocoalele de securitate. Claude Code operează cu acces la sistemul de fișiere și poate executa comenzi în terminal, ceea ce îl face semnificativ mai periculos decât un chatbot obișnuit dacă este manipulat incorect sau dacă instrucțiunile sunt compromise.

Instrucțiunile abordează explicit categoriile de operații riscante. Acestea includ operații distructive - ștergerea fișierelor sau a ramurilor git - operații greu reversibile, cum ar fi forțarea unui push sau resetarea hard, acțiunile vizibile pentru alții, inclusiv crearea de pull request-uri sau trimiterea de mesaje, și încărcarea de conținut pe servicii terțe.

Principiul confirmării înainte de acțiune

Un principiu recurent în instrucțiunile de securitate este cel al confirmării înainte de a acționa în situații cu risc ridicat. Claude Code este instruit să comunice transparent despre acțiunile planificate și să solicite confirmarea utilizatorului, urmând logica „măsoară de două ori, taie o singură dată".

Sistemul nu trebuie să trateze aprobarea unei acțiuni riscante dintr-un singur context ca pe o autorizare generală pentru situații similare viitoare. Există instrucțiuni specifice despre cum să gestioneze situațiile în care un pre-commit hook eșuează - documentul precizează că, în astfel de cazuri, commit-ul nu a avut loc și nu trebuie utilizată comanda de amendare, ci unul nou.

Exploreaza directorul de firme din Romania.

Limitele etice și asistența pentru securitate cibernetică

Instrucțiunile abordează și subiectul securității cibernetice. Claude Code este configurat să ajute cu testarea de securitate autorizată, provocările CTF (Capture The Flag) și contextele educaționale. Sistemul refuză solicitările pentru tehnici distructive, atacuri de tip denial-of-service, compromiterea lanțului de aprovizionare sau evaziunea detecției în scopuri malițioase.

Instrumentele cu dublă utilizare, cum ar fi framework-urile de tip command-and-control sau testarea credențialelor, necesită un context clar de autorizare înainte ca AI-ul să ofere asistență. Aceste limite sunt descrise în detaliu în documentul scurs, oferind cercetătorilor o imagine completă a granițelor etice impuse sistemului.

Agenții specializați și arhitectura multi-agent a Claude Code

Un element surprinzător al system prompt-ului scurs este descrierea sistemului de agenți specializați. Claude Code poate delega sarcini unor sub-agenți cu capabilități specifice: agenți pentru explorarea bazei de cod, agenți pentru planificarea implementării, agenți pentru rezolvarea problemelor complexe și agenți specializați pentru diferite domenii tehnice.

Instrucțiunile ghidează Claude Code în privința utilizării instrumentelor disponibile: când să folosească un instrument de căutare față de unul de citire a fișierelor, cum să paralelizeze apelurile de instrumente independente și cum să gestioneze dependențele dintre operații secvențiale. Este, în esență, o metodologie de management de proiect aplicată unui sistem AI.

Această arhitectură multi-agent reflectă tendința actuală din industrie de a construi sisteme AI mai complexe, compuse din mai mulți agenți specializați care colaborează pentru a rezolva probleme care depășesc capacitatea unui singur model. Scurgerea oferă o imagine rară a modului în care astfel de sisteme sunt orchestrate în practică, inclusiv mecanismele de transmitere a sarcinilor și de agregare a rezultatelor.

Implicațiile pentru transparența AI și dezbaterea din industrie

Scurgerea system prompt-ului Claude Code a reînviat dezbaterea despre cât de transparent ar trebui să fie companiile de AI față de utilizatori și față de publicul larg. Există două perspective distincte, fiecare cu argumente solide.

Susținătorii transparenței argumentează că utilizatorii au dreptul să știe cum funcționează sistemele AI cu care interacționează, mai ales atunci când aceste sisteme au acces la date sensibile sau pot efectua acțiuni cu consecințe reale. Din această perspectivă, scurgerea este, paradoxal, benefică pentru ecosistemul AI, deoarece forțează o conversație despre responsabilitate și control.

Companiile argumentează, dimpotrivă, că instrucțiunile interne reprezintă proprietate intelectuală valoroasă și că publicarea lor poate ajuta actorii rău-intenționați să găsească modalități de a manipula sistemele AI. Dacă un atacator știe exact cum este configurat un sistem, poate căuta mai eficient punctele slabe și tehnicile de eludare a restricțiilor.

Pentru mai multe optiuni, consulta oferte de munca disponibile acum.

Perspectiva cercetătorilor de securitate asupra documentului scurs

Cercetătorii de securitate care au analizat documentul au remarcat nivelul ridicat de detaliu al instrucțiunilor. Protocoalele pentru operațiile distructive, în special, arată că Anthropic a gândit cu atenție scenariile de risc. Rămân, totuși, întrebări despre dacă instrucțiunile sunt suficient de robuste pentru a preveni manipularea prin tehnici avansate de injecție de prompt.

Injecția de prompt este o metodă prin care un atacator introduce instrucțiuni malițioase în datele pe care AI-ul le procesează, cu scopul de a-l face să ignore instrucțiunile originale și să execute comenzi neautorizate. Într-un instrument cu acces la sistemul de fișiere, consecințele pot fi grave, inclusiv ștergerea de date sau executarea de cod malițios în contextul utilizatorului vizat.

AI Act european și transparența obligatorie

Scurgerea vine în contextul implementării treptate a Regulamentului european privind inteligența artificială (AI Act), care impune cerințe de transparență pentru sistemele AI cu risc ridicat. Dezbaterea despre dacă instrucțiunile interne ar trebui să fie publice se suprapune cu discuțiile legislative despre ce informații ar trebui să dezvăluie obligatoriu companiile AI. Unii experți consideră că incidente de acest tip vor accelera aceste conversații la nivel de politici publice.

Ce schimbă această scurgere pentru viitorul sistemelor AI

Pentru utilizatorii obișnuiți ai Claude Code, scurgerea nu modifică în mod direct experiența zilnică. Instrumentul continuă să funcționeze conform specificațiilor Anthropic, iar instrucțiunile interne, chiar dacă sunt acum publice, nu pot fi alterate de utilizatori obișnuiți.

Scurgerea are, totuși, un efect de demistificare parțială a modului în care funcționează sistemele AI avansate. Utilizatorii pot vedea că un sistem AI sofisticat este, în mare parte, un set elaborat de instrucțiuni în limbaj natural, completat cu protocoale specifice pentru diferite situații. Nu există magie în spate, ci inginerie meticuloasă și sute de decizii de design explicate în limbaj comun.

Comunitatea de dezvoltatori a primit documentul cu un amestec de curiozitate și analiză critică. Unii au apreciat principiile de inginerie software încorporate în instrucțiuni, considerându-le bune practici pe care orice dezvoltator ar trebui să le urmeze indiferent de context. Alții au ridicat întrebări despre autonomia crescândă a sistemelor AI și despre granița dintre asistență și înlocuire în procesul de dezvoltare software.

Pe termen lung, incidentele de acest tip pot modela standardele industriei privind transparența AI. Presiunea din partea comunității de securitate și a cercetătorilor, combinată cu reglementările europene în curs de implementare, ar putea conduce la un echilibru mai bun între protecția proprietății intelectuale și dreptul utilizatorilor de a înțelege instrumentele pe care le folosesc zilnic.

Întrebări frecvente

Ce este un system prompt și de ce este important pentru un AI?

Un system prompt este setul de instrucțiuni pe care o companie îl transmite unui model AI înainte ca utilizatorul să înceapă conversația. Acestea definesc comportamentul, limitele etice și modul de răspuns al AI-ului. Practic, transformă un model AI gol într-un produs specific, cu personalitate și reguli clare de funcționare, diferențiind produse comerciale de modelele de bază.

Claude Code poate efectua acțiuni dăunătoare prin manipularea instrucțiunilor?

Claude Code are acces la sistemul de fișiere și poate executa comenzi în terminal, ceea ce îl face mai sensibil decât un chatbot obișnuit. Instrucțiunile interne includ protocoale stricte pentru operațiile riscante și solicită confirmare înainte de acțiuni distructive. Cercetătorii de securitate avertizează că tehnicile avansate de injecție de prompt pot reprezenta totuși un vector de atac.

Ce este injecția de prompt și cum poate afecta sistemele AI?

Injecția de prompt este o tehnică prin care un atacator introduce instrucțiuni malițioase în datele procesate de AI, determinând sistemul să ignore instrucțiunile originale și să execute comenzi neautorizate. Într-un instrument cu acces la sistemul de fișiere, consecințele pot include ștergerea datelor, executarea de cod malițios sau exfiltrarea de informații sensibile fără știința utilizatorului.

Ce consecințe juridice poate avea scurgerea unui system prompt?

Din punct de vedere juridic, system prompt-urile sunt considerate proprietate intelectuală. Scurgerea lor poate reprezenta o încălcare a drepturilor de autor sau a secretului comercial, expunând persoana responsabilă unor acțiuni legale din partea companiei afectate. Regulamentul european AI Act aduce cerințe suplimentare de transparență care pot complica delimitarea dintre obligația de divulgare și protecția proprietății intelectuale.

Alte companii AI au trecut prin situații similare de scurgere a instrucțiunilor interne?

Da, scurgeri similare au vizat în ultimii ani ChatGPT, Gemini și alte platforme AI majore. Aceste incidente au generat dezbateri recurente despre transparența în industria AI. Unele companii au ales ulterior să publice voluntar părți din instrucțiunile lor ca strategie de comunicare deschisă, considerând că transparența parțială controlată este preferabilă scurgerilor necontrolate.